OpenClaw mit Ollama nutzen: Lokales KI-Gateway installieren und starten

OpenClaw lässt sich mit Ollama zu einem lokalen KI-Gateway für Chat, Agentenlogik und Tools kombinieren. So können große Sprachmodelle vollständig auf dem eigenen System betrieben werden. Diese Anleitung zeigt Schritt für Schritt, wie OpenClaw installiert, ein Modell geladen und samt Dashboard, Messaging-Kanal und Skills eingerichtet wird.

Lassen Sie sich von den Vorteilen überzeugen. Probieren Sie Ihren Virtual Server ganz in Ruhe 30 Tage lang aus!

Schritt 1: Eigener Server als Basis

Der praktische Mehrwert, OpenClaw und Ollama selbst zu hosten, liegt vor allem in fünf Punkten:

- Die Modellverarbeitung bleibt auf der eigenen Infrastruktur, was für Datenschutz, Vertraulichkeit und Compliance oft der wichtigste Grund ist.

- Der Aufbau ist transparenter, weil OpenClaw als Open-Source-System dokumentiert und konfigurierbar ist.

- Man behält die volle Kontrolle über Modellwahl, Skills, Dienste und Startverhalten.

- Der Kernbetrieb eines solchen Setups kann grundsätzlich auch ohne externe Modell-API funktionieren, sofern bewusst nur lokale Modelle und lokale Werkzeuge genutzt werden.

- OpenClaw ist agentenorientiert gebaut. Das System ist also nicht nur ein Chatfenster für ein Modell, sondern eine Arbeitsumgebung mit Skills, Tools, Workspace und Weboberfläche.

Auf einem eigenen Server können Sie dann beispielsweise auch Ihre eigene OpenClaw-Docker-Installation einrichten, die sich perfekt mit Ollama kombinieren lässt.

OpenClaw hat umfangreiche Systemrechte. Der Agent kann beispielsweise Shell-Befehle ausführen, Dateien lesen oder Skripte starten. Installieren Sie Skills nur aus vertrauenswürdigen Quellen und beschränken Sie Zugriffsrechte. Im Idealfall läuft OpenClaw in einer isolierten Umgebung wie einem Container oder einer VM.

Schritt 2: Voraussetzungen

Bevor die Einrichtung beginnt, sollten einige Grundbedingungen erfüllt sein:

- Ein unterstütztes Betriebssystem: Linux, macOS oder Windows

- Eine funktionierende Terminal- beziehungsweise Shell-Umgebung wie WSL2, SSH oder Docker

- Internetzugang für die Erstinstallation von OpenClaw und Ollama

- Genügend Arbeitsspeicher sowie CPU- und GPU-Ressourcen: Für größere Modelle sind mindestens 8 bis 16 GB RAM, optional 12 GB VRAM und ein Prozessor auf der Leistungsstufe eines Intel Core i5 oder AMD Ryzen 5 empfohlen

OpenClaw benötigt außerdem Node.js 22 oder neuer. Bei Verwendung des offiziellen Installationsskripts muss Node.js jedoch in der Regel nicht separat manuell installiert werden, da der Installer die Laufzeit bei Bedarf selbst einrichtet.

Schritt 3: Ollama installieren

Ollama ist eine LLM-Laufzeitumgebung, die KI-Modelle lokal ausführt. OpenClaw verbindet sich später mit Ollama, um dieses Modell für Chats, Analysen und Agentenfunktionen zu nutzen. Offiziell läuft Ollama auf macOS, Windows und Linux und stellt nach der Installation automatisch eine lokale API bereit.

Die Installation kann über die offizielle Website von Ollama, oder alternativ direkt über das Terminal erfolgen:

| Betriebssystem | Installation |

|---|---|

| Linux | `curl -fsSL https://ollama.com/install.sh |

| macOS | `curl -fsSL https://ollama.com/install.sh |

| Windows | `iwr https://ollama.com/install.ps1 |

Schritt 4: OpenClaw installieren

OpenClaw bildet im Setup die zentrale Ausführungsschicht: Es nimmt später Anfragen aus der Weboberfläche entgegen, lädt den Workspace mit den definierten Skills, führt lokale Werkzeuge wie Shell-Befehle oder Python-Skripte aus und koordiniert den gesamten Ablauf zwischen Oberfläche, Agentenlogik und Modellanbindung.

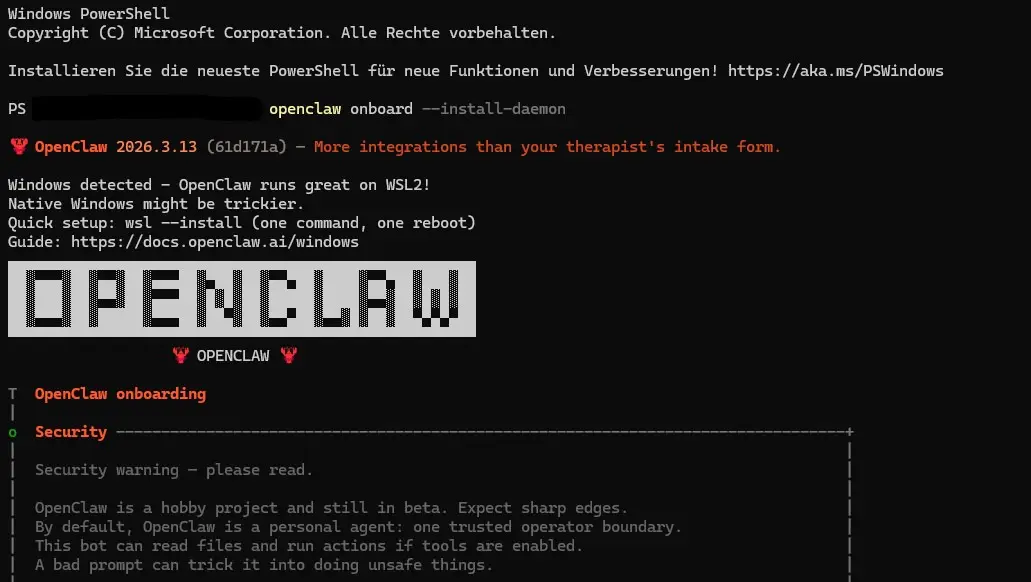

Zur Installation wird unter Windows der folgende Befehl im Terminal eingegeben:

iwr -useb https://openclaw.ai/install.ps1 | iexIn Linux- oder macOS-Systemen lautet der entsprechende Befehl:

curl -fsSL https://openclaw.ai/install.sh | bashDanach kann der Onboarding-Prozess gestartet werden:

openclaw onboard --install-daemonNach der Installation können die folgenden drei Befehle verwendet werden, um den aktuellen Stand zu checken:

openclaw doctor: Prüft, ob es Konfigurationsfehler gibtopenclaw status: Zeigt den Gateway-Status anopenclaw dashboard: Öffnet das Dashboard im Browser

Schritt 5: Onboarding

Beim Onboarding hilft OpenClaw Ihnen, auf Ihrem Rechner eine lokale KI-Umgebung einzurichten. Der Prozess leitet Sie durch eine Reihe von Auswahlmöglichkeiten, um die Einrichtung möglichst einfach zu machen.

Dabei wird ein lokales Gateway eingerichtet – eine kleine Schnittstelle, über die Programme mit der KI kommunizieren können. Dieses Gateway läuft standardmäßig nur auf Ihrem Rechner, wodurch kein Zugriff von außen möglich ist.

In diesem Prozess richten Sie auch direkt das Modell ein. Für größere Kontextfenster sind bei komplexen Agent-Workflows 64.000 AI-Tokens hilfreich. Unterhalb dieser Grenze kann der Agent bei mehrstufigen Aufgaben den Überblick über Gesprächsverlauf, Dateiinhalte und Instruktionen verlieren. Typische Tool-fähige Modelle aus Ollama sind unter anderem:

qwen3-coderglm-4.7-flashgpt-oss:20bqwen3:8b

Falls das gewünschte Modell nicht zur Auswahl steht, kann es auch manuell gesucht werden. Aktuell lädt OpenClaw für Ollama automatisch das Modell glm-4.7-flash herunter und stellt es ein.

Zum Schluss wird das Gateway mit einem Port, einer lokalen Bindung und einem Zugriffstoken konfiguriert, damit nur autorisierte Programme auf die KI zugreifen können.

Schritt 6: Messaging-Kanal verbinden und Web Search einrichten

Eines der Hauptmerkmale von OpenClaw ist die Anbindung an Messaging-Dienste, über die Sie Aufgaben direkt aus WhatsApp, Telegram, Slack, Discord oder iMessage an den lokalen Agenten schicken können. Die Einrichtung eines Kanals erfolgt ebenfalls noch im Onboarding-Prozess, kann aber auch nachgeholt werden:

openclaw channels list

openclaw channels addDer interaktive Assistent führt Sie durch die plattformspezifische Authentifizierung:

- WhatsApp: QR-Code scannen über die „Geräte verknüpfen“-Funktion

- Telegram: Bot-Token eingeben (über @BotFather erstellt)

- Slack / Discord: OAuth-Authentifizierung über einen Browser-Link

- iMessage: Nur auf macOS, erfordert aktive iMessage-Anmeldung

Sobald ein Kanal verbunden ist, kann man Aufgaben direkt aus der jeweiligen App an OpenClaw schicken. Der Agent verarbeitet sie dann lokal mit dem konfigurierten Ollama-Modell.

Nach der Auswahl des Messaging-Dienstes bittet Sie OpenClaw, einen Web Search Service anzugeben. Dabei können Sie beispielsweise ein bestehendes Gemini-Abonnement per API-Code mit OpenClaw verbinden, um die Onlinesuche zu gewährleisten.

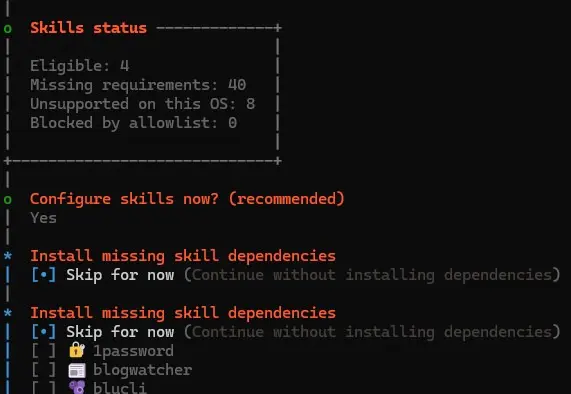

Schritt 7: Skills einrichten

Workspace Skills erweitern OpenClaw um eigene, lokal verfügbare Fähigkeiten. Technisch besteht ein Skill aus einem eigenen Ordner innerhalb des Workspace, der mindestens eine Datei namens SKILL.md enthält. Diese Datei kombiniert YAML-Frontmatter für die Metadaten mit Markdown-Anweisungen für das Verhalten des Agenten. OpenClaw lädt solche Workspace-Skills aus dem Skill-Verzeichnis des Workspace und kann Änderungen daran automatisch erkennen, wenn das Beobachten von Skills aktiviert ist. Workspace-Skills sind besonders nützlich, um dem Agenten wiederkehrende Aufgaben, bevorzugte Arbeitsweisen oder projektspezifisches Wissen mitzugeben.

Beim Onboarding sind bereits einige Skills vorhanden, die direkt ausgewählt und eingestellt werden können. Darunter beispielsweise eine Verknüpfung mit dem Google-Ökosystem, eine Sprache-zu-Text-API oder ein Agent, der Inhalte zusammenfasst.

Eigene Skills werden in der Regel unter ~/.openclaw/workspace/skills/ angelegt. Für einen ersten praxisnahen Anwendungsfall bietet sich zum Beispiel ein Skill an, der aus Rohnotizen strukturierte Besprechungsnotizen erstellt. So erhält OpenClaw eine klar definierte Aufgabe, die im Alltag tatsächlich nützlich ist, ohne bereits komplexe Workflow-Logik oder direkte Tool-Weiterleitung zu benötigen:

mkdir -p ~/.openclaw/workspace/skills/meeting-notes

nano ~/.openclaw/workspace/skills/meeting-notes/SKILL.mdIn diese Datei kann anschließend folgende Skill-Definition eingefügt werden:

---

name: meeting_notes

description: Erstellt aus Rohnotizen strukturierte Besprechungsnotizen mit Aufgaben und offenen Punkten.

---

# Meeting Notes Skill

Nutze diesen Skill, wenn der Nutzer unsortierte Besprechungsnotizen,

Stichpunkte oder Gesprächsmitschnitte in eine klare Zusammenfassung

überführen möchte.

Deine Aufgabe:

- Fasse die wichtigsten Themen in wenigen Sätzen zusammen.

- Erstelle eine Liste der besprochenen Entscheidungen.

- Trenne klar zwischen Aufgaben, offenen Fragen und nächsten Schritten.

- Formuliere sachlich, präzise und gut lesbar.

- Wenn Informationen fehlen oder unklar sind, kennzeichne diese deutlich.

Gewünschtes Ausgabeformat:

1. Kurzfassung

2. Entscheidungen

3. Aufgaben

4. Offene Fragen

5. Nächste SchritteSobald die Datei gespeichert ist, erkennt OpenClaw den neuen Skill automatisch im Workspace. Wenn die Skill-Beobachtung aktiviert ist, werden Änderungen an der SKILL.md sogar ohne Neustart des Gateways übernommen.

Schritt 8: Hooks aktivieren

Hooks sind in OpenClaw ein erweiterbares, ereignisgesteuertes Automatisierungssystem. Sie ermöglichen es, automatisch bestimmte Aktionen auszuführen, sobald ein Agent einen Befehl ausführt oder ein bestimmtes Ereignis eintritt. OpenClaw erkennt Hooks selbstständig, wenn sie in den vorgesehenen Verzeichnissen abgelegt werden, und sie können anschließend über die Kommandozeile verwaltet werden.

Standardmäßig bietet OpenClaw im Onboarding vier Hooks an, die direkt aktiviert werden können:

- session-memory: Speichert automatisch den Kontext Ihrer aktuellen Sitzung im Agent-Workspace (

~/.openclaw/workspace/memory/), sobald Sie den Befehl/newausführen. - bootstrap-extra-files: Lädt beim Start eines Agenten zusätzliche Dateien in den Workspace, basierend auf vorher definierten Pfaden oder Dateimustern.

- command-logger: Protokolliert alle ausgeführten Befehle und speichert sie in der Logdatei

~/.openclaw/logs/commands.log. - boot-md: Führt beim Start des Gateways automatisch eine

BOOT.md-Datei aus, in der Startanweisungen oder Initialisierungen für den Agenten stehen können.

Die gesamte Liste an Hooks lässt sich auch im Nachhinein noch über openclaw hooks list ausgeben. Einzelne Hooks werden über den Befehl openclaw hooks enable xy aktiviert.

Schritt 9: Gateway starten

Erst nachdem OpenClaw installiert, Ollama eingerichtet, das Modell geladen und die Konfiguration gesetzt wurde, geht es ans Gateway:

openclaw gateway --port 18789Mit diesem Befehl wird das Gateway lokal gestartet und stellt das Dashboard unter der Standardadresse http://127.0.0.1:18789 bereit.

Ob der Dienst korrekt läuft, lässt sich zusätzlich prüfen mit:

openclaw gateway statusAls gesunde Basis gelten dabei insbesondere die Meldungen „Runtime: running“ und „RPC probe: ok“.

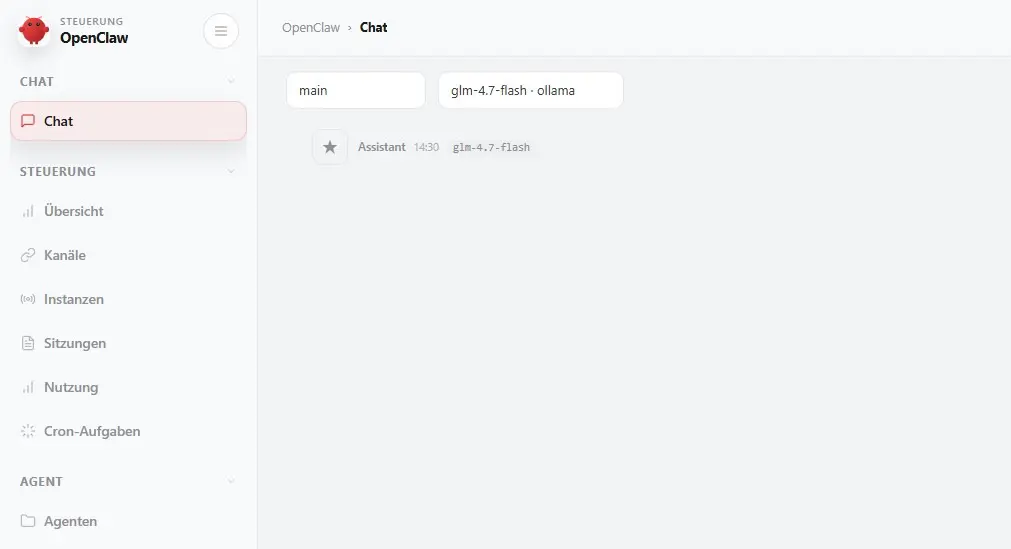

Schritt 10: Dashboard testen

Da die Interaktion mit dem Bot hauptsächlich über die eingerichteten Messaging-Dienste abläuft, ist das integrierte Dashboard kein notwendiger Bestandteil des laufenden Betriebs. Für die erste Inbetriebnahme ist eine kurze Begutachtung aber dennoch sinnvoll: Es zeigt auf einen Blick, ob das Gateway läuft, ob das Modell korrekt erkannt wurde und ob die Konfiguration valide ist. Wer OpenClaw auf einem Desktop-Rechner betreibt, kann es auch als gelegentliches Diagnosewerkzeug nutzen.

Das Dashboard lässt sich entweder direkt im Browser öffnen oder per CLI aufrufen:

openclaw dashboardAlternativ wird die Weboberfläche direkt über die Gateway-Adresse http://127.0.0.1:18789 geöffnet. Falls beim ersten Aufruf eine Authentifizierung verlangt wird, kann das Gateway-Token ausgelesen werden:

openclaw config get gateway.auth.tokenDieses Token wird dann im Control UI hinterlegt. Lokale Verbindungen über 127.0.0.1 werden in der Regel automatisch akzeptiert. Bei Zugriffen von anderen Geräten kann zusätzlich ein Pairing notwendig sein:

openclaw devices list

openclaw devices approve <requestId>Damit wird der neue Browser oder das neue Gerät als vertrauenswürdig markiert. Diese zusätzliche Freigabe ist besonders sinnvoll, weil das Dashboard nicht nur ein Chatfenster, sondern eine administrative Oberfläche mit Zugriff auf Skills, Konfiguration und Ausführungsfreigaben ist.

Schritt 11: OpenClaw individualisieren

Damit ist die Grundeinrichtung von OpenClaw mit Ollama abgeschlossen. Das Gateway läuft lokal, das Modell ist eingebunden und der Agent kann über Messaging-Dienste oder das Dashboard angesprochen werden. In dieser Grundkonfiguration lässt sich OpenClaw bereits produktiv nutzen, um Nachrichten zu analysieren, Informationen zusammenzufassen oder einfache Aufgaben automatisch ausführen zu lassen.

Das System ist jedoch bewusst modular aufgebaut und bietet deutlich mehr Möglichkeiten als das hier gezeigte Basissetup. Zu den typischen Erweiterungen gehören unter anderem:

- Weitere Skills entwickeln: Wiederkehrende Aufgaben wie Meeting-Zusammenfassungen, Codeanalyse oder Dokumentstrukturierung als eigene Skills definieren und dem Agenten dauerhaft zur Verfügung stellen.

- Automatisierungen über Hooks aufbauen: Ereignisse wie neue Sitzungen, Befehlsausführungen oder Agentenstarts zu automatischen Aktionen definieren.

- Lokale Werkzeuge integrieren: OpenClaw kann Shell-Befehle, Python-Skripte oder eigene Tools ausführen. Dadurch wird der Agent zu einer Art lokalen Automatisierungsplattform.

- Mehrere Modelle kombinieren: Neben dem primären Modell können Fallback-Modelle oder spezialisierte Modelle für bestimmte Aufgaben konfiguriert werden.

- Weitere Messaging-Dienste anbinden: Zusätzliche Kanäle wie Slack, Discord oder Telegram lassen sich parallel betreiben, sodass mehrere Geräte oder Teams mit dem lokalen Agenten arbeiten können.

- Workspace und Wissensbasis erweitern: Dokumente, Projektdateien oder Notizen können im Workspace abgelegt werden, sodass der Agent sie als Kontext für seine Aufgaben nutzen kann.

- Remote-Zugriff einrichten: Über Lösungen wie Tailscale oder Reverse Proxies kann das Dashboard auch sicher von anderen Geräten aus erreichbar gemacht werden.

- Inspiration suchen: OpenClaw stellt mit der „What People Are Building“-Website eine eigene Übersicht bereit, in der gezeigt wird, was andere Nutzerinnen und Nutzer mit dem Tool machen.

Das hier gezeigte Setup bildet also nur den Einstiegspunkt. Sobald OpenClaw stabil läuft, lohnt es sich, die eigenen Workflows schrittweise durch zusätzliche Skills, Automatisierungen oder neue Integrationen zu erweitern. Gerade in Kombination mit lokalen Modellen über Ollama entsteht so eine flexible, vollständig selbst gehostete KI-Arbeitsumgebung, die sich genau an die eigenen Anforderungen anpassen lässt.